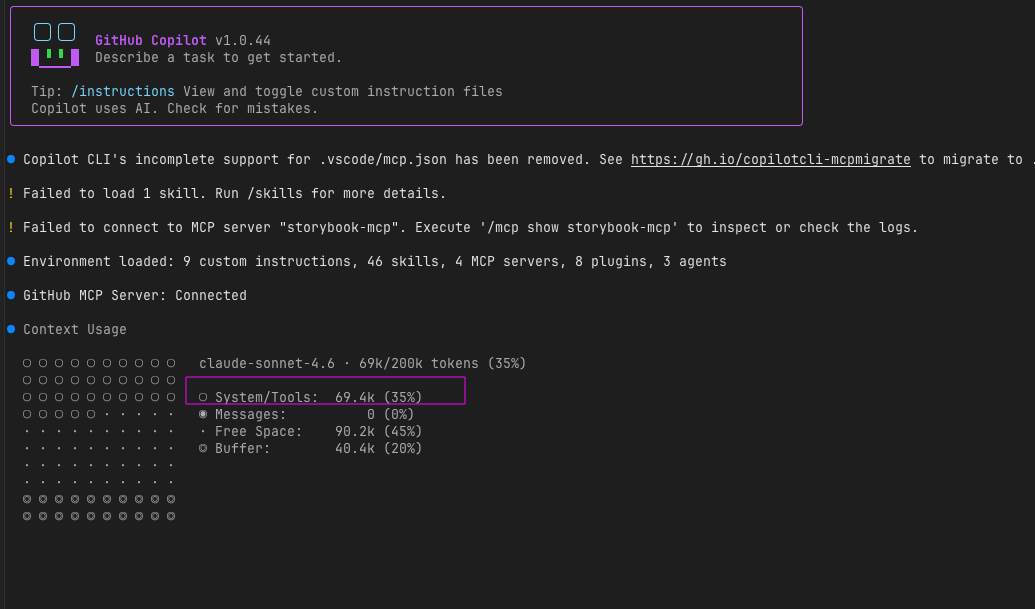

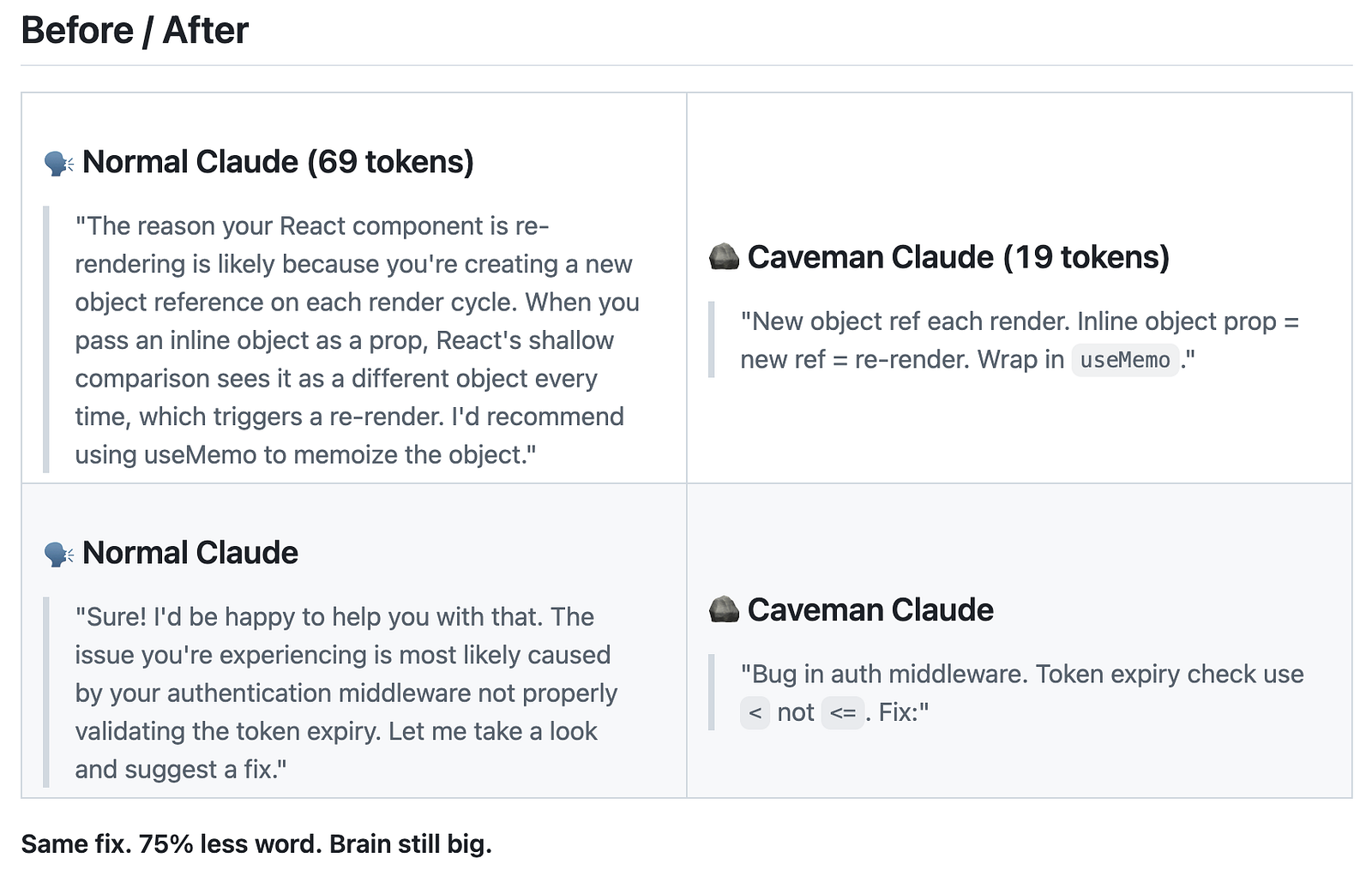

- GitHub Copilot passe à la facturation à l'usage, au token consommé, dès juin.

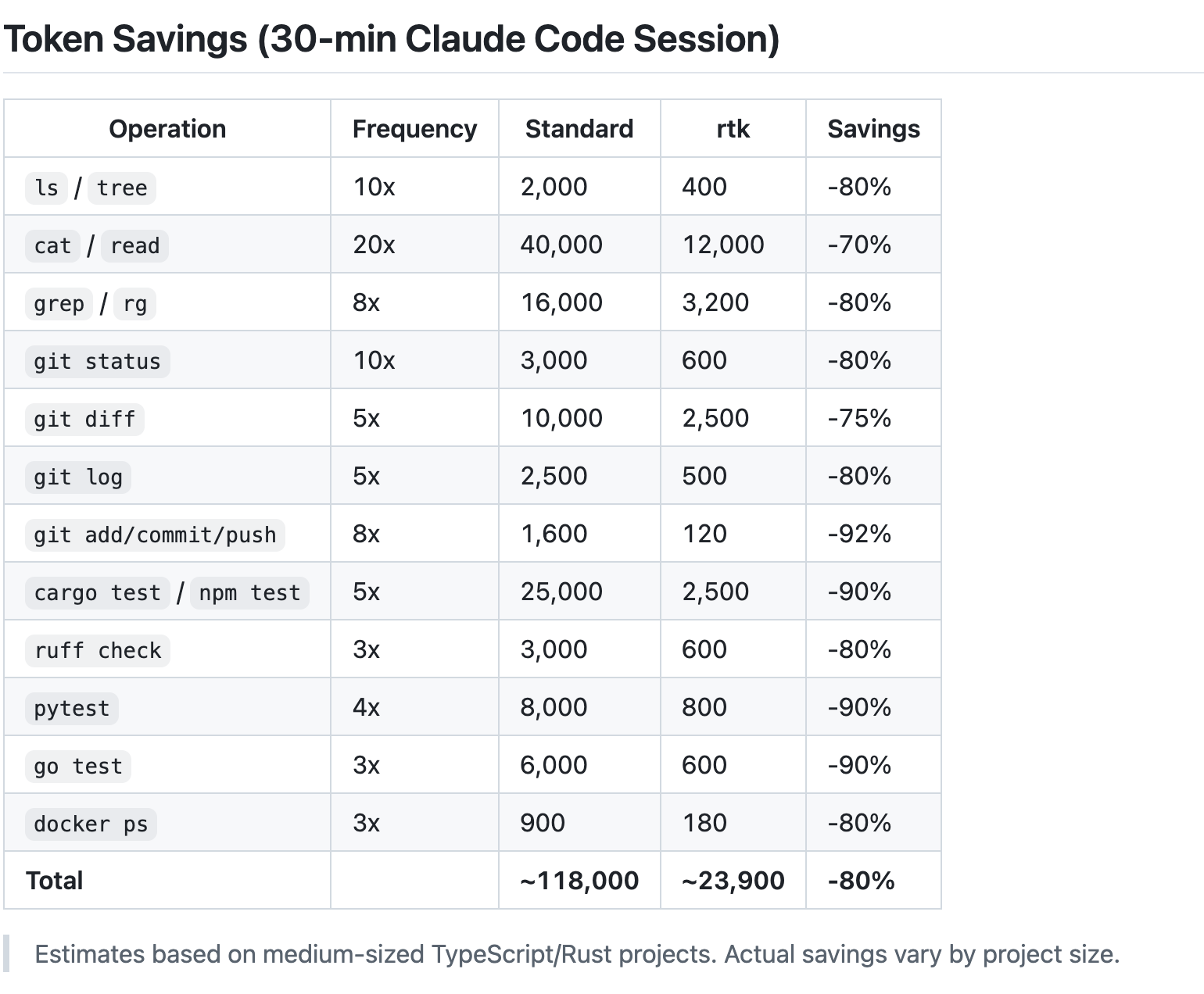

- Les modèles deviennent plus performants, mais aussi plus coûteux.

- L'ère de l'expérimentation sans limite est terminée.

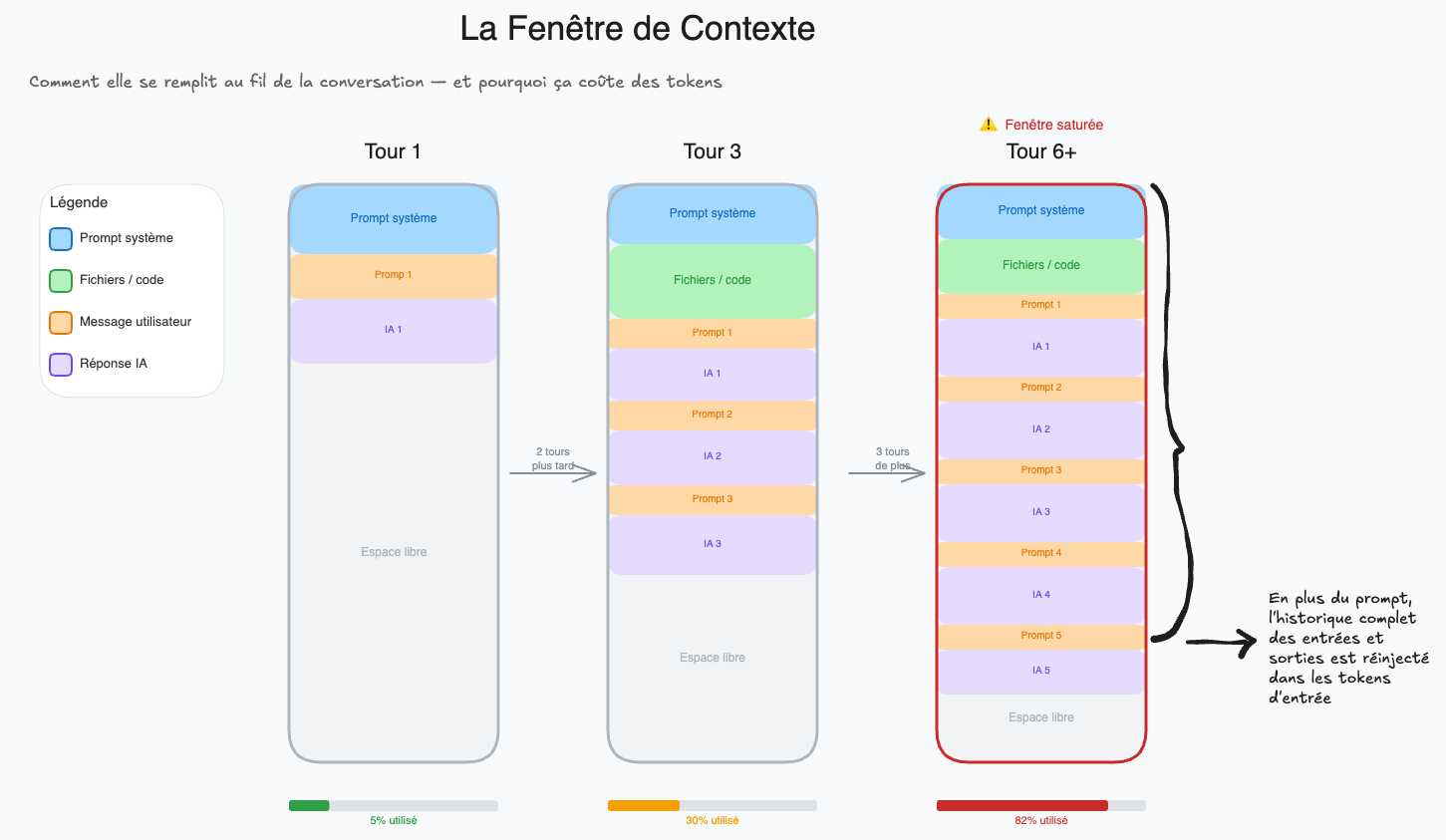

- Économiser des tokens, c'est aussi moins d'hallucinations, plus d'efficacité et une empreinte énergétique réduite.

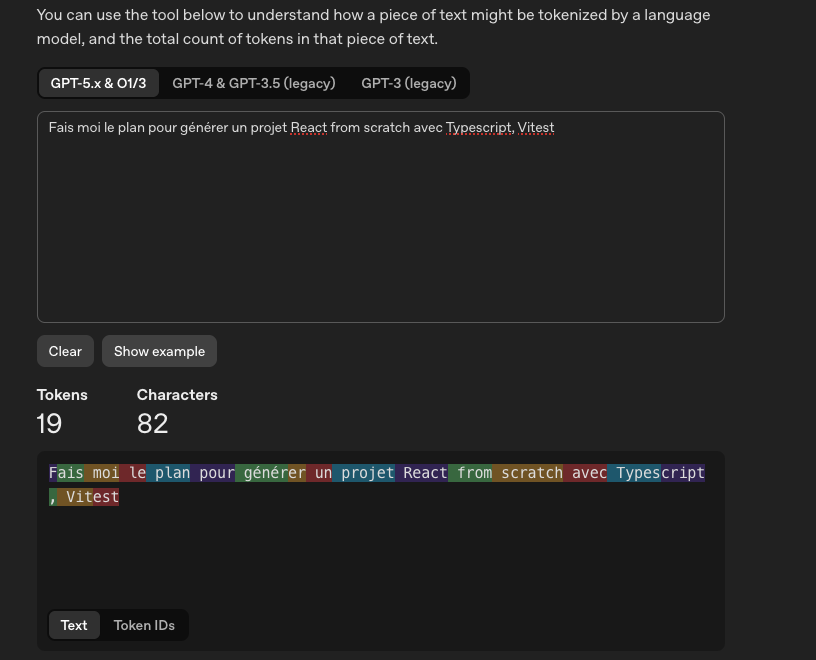

Chaque token compte. Littéralement.